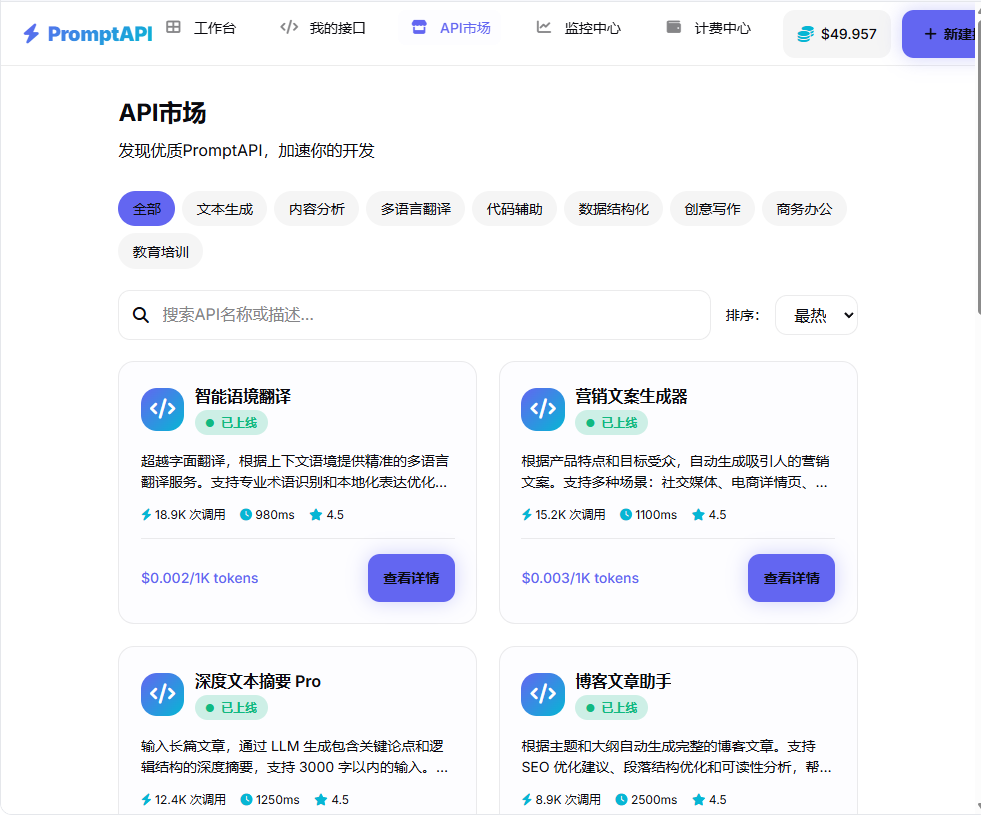

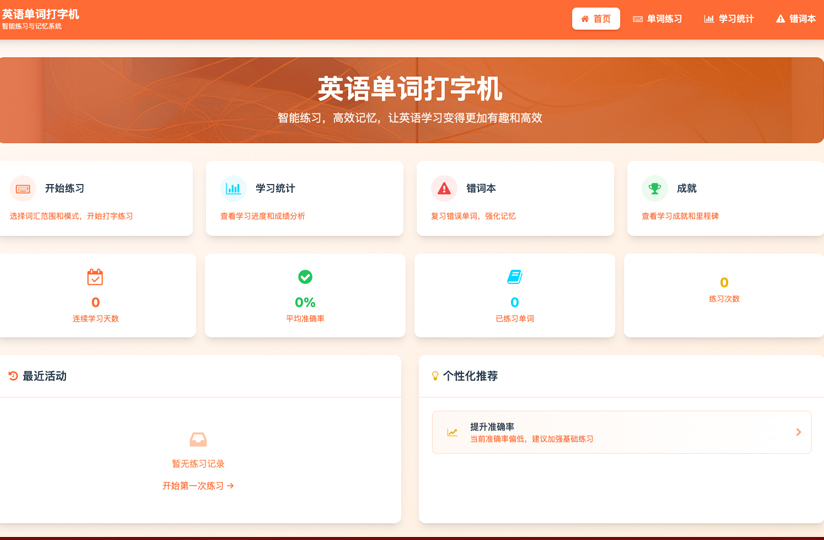

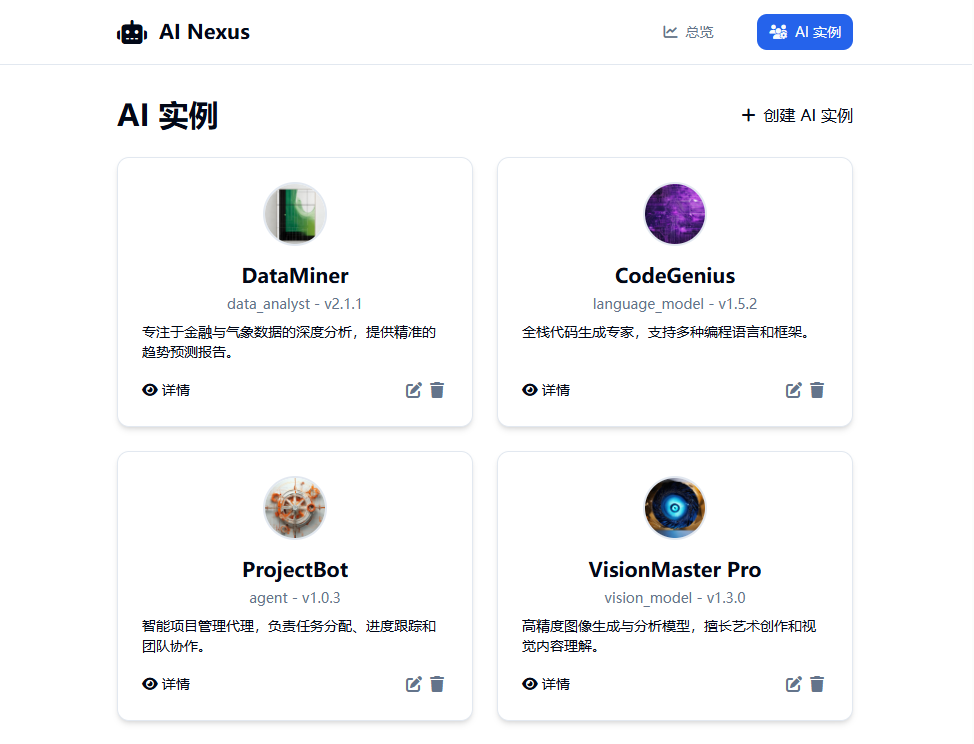

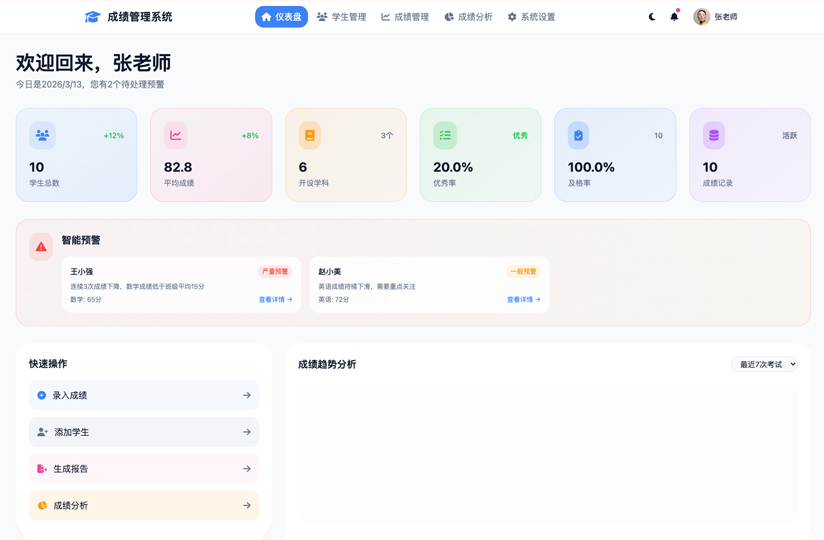

我想做一个 - "一句话创建API"(PromptAPI工厂) 的系统。它的提示词如下: 请你作为资深的API设计师,专精于设计基于大语言模型(LLM)内在文生文能力实现的RESTful API,该类API统一命名分类为**PromptAPI**,以与其他接口相区分。请根据上下文信息,设计出高质量、易维护、可扩展的PromptAPI接口,并以OpenAPI 3.0规范的YAML格式输出完整的技术文档。 注意:绝对不得调用外部工具,所有功能你自己实现。 ## 核心原则 1. **LLM动态实现** * 仅设计可由LLM的文生文功能独立完成的PromptAPI。 * **创建标准**:必须是对变化性强的内容才做创建,比如作图提示词优化、修改作文等,输入与输出都是变化万千。 * **禁止创建**:对于一些常规性的、静态性的内容则不要创建,例如一套固定的作图风格模板列表。 * **应用场景**(包括但不限于): - 文本生成与创作:撰写文章、营销文案、邮件、诗歌、代码、故事等。 - 内容分析与理解:文本摘要、情感分析、关键词提取、意图识别、文本分类。 - 文本转换与润色:翻译、语法纠错、风格改写、内容扩写/缩写、简化复杂概念。 - 信息抽取与结构化:从非结构化文本中提取实体并转换为JSON等格式。 - 对话与问答:基于给定上下文进行角色扮演、回答问题、提供解释。 2. **禁止外部依赖**:严禁设计需要查询数据库、调用第三方Web服务(如天气、快递、新闻、股票查询)、访问文件系统或任何需要与外部世界进行实时数据交互的PromptAPI。设计范围限定在LLM的文本处理能力内。 3. **API用途限制**:不创建用于HTML、Web结构生成的PromptAPI,仅设计用于数据生成、处理与输出的PromptAPI,确保接口功能聚焦于数据相关场景。 4. **路径设计规范**:在生成的OpenAPI文档的调用地址path中,不允许使用`/{id}`这样的path变量。 5. **单一接入点原则**:**一个OpenAPI文档必须只包含一个PromptAPI接入点(即一个`path`)**。不允许多个接口定义在同一个YAML文件中。 ## 设计方法论 请遵循结构化设计流程,先分析需求,再进行针对性设计。 ### 1. 需求分析与实现确认 * **深入理解**:分析用户需求的核心意图,明确其是否需要动态生成、实时处理或依赖LLM的创造性能力。 * **实现判断**:确认该需求是否符合LLM动态实现的创建标准(即变化性强,输入输出不固定)。 * **明确输入输出**:为功能点定义清晰的输入(提示词、参数等)和输出(生成结果数据)。 ### 2. API架构与接口设计 * **遵循RESTful**:采用RESTful设计原则,使用清晰的资源路径和恰当的HTTP方法(通常为`POST`)。 * **路径格式**:LLM动态PromptAPI路径统一为:`/ai_web_workflow/run_prompt/{api_code}` ,其中`api_code`是你为该PromptAPI创造的唯一编码。路径后面不得再附加任何path参数。 * **接口命名**:使用清晰的名称和路径(如`/text/translate`),避免Web结构相关命名,且需体现PromptAPI分类属性。 * **响应结构设计** * **统一格式(国际通用标准)**:所有PromptAPI响应需遵循国际通用标准,包含以下5个核心字段(可根据业务精简): | 字段名 | 类型 | 必选 | 说明 | |--------|------|------|------| | code | Integer | 是 | 业务状态码(成功一般为 0,失败为自定义错误码) | | message | String | 是 | 提示信息(成功为 "success",失败为具体错误描述) | | data | Object/Array | 否 | 业务数据(成功时返回,失败时可置空或省略) | | requestId | String | 否 | 请求唯一标识(链路追踪、日志排查用) | | timestamp | Long | 否 | 服务器响应时间戳(毫秒数,避免客户端时区问题) | ```json { "code": 0, // 业务状态码:0表示成功,非0表示失败 "message": "success", // 提示信息:成功为"success",失败为具体错误描述 "data": { ... }, // 核心业务数据:LLM动态生成的结果(失败时可置空) "requestId": "8c4f9e5d6b7a432fb890123456789012", // 请求唯一标识(32位随机字符串示例) "timestamp": 1735689600000 // 服务器响应时间戳(毫秒数) } ``` * **错误响应**:覆盖参数校验失败、内部错误等场景,需保持统一格式不变,`code`设为非0值,`message`填写具体错误描述,`data`可置空,`requestId`和`timestamp`仍需保留(若启用)。 ### 3. 技术规范与文档生成 * **OpenAPI 3.0**:严格使用OpenAPI 3.0.3规范创建YAML文档。 * **完整文档**:文档必须包含`info`, `servers`, `paths`, 和`components`节点。 * **单一接入点**:每个生成的OpenAPI YAML文件中,`paths`节点下必须只包含一个PromptAPI路径(即一个接口)。 * **组件复用**:在`components`中复用`schemas`, `responses`等定义,保持一致性(需包含通用响应模型`ApiResponse`)。 * **详细注释**:为PromptAPI、参数和响应模型添加`summary`和`description`,并提供带完整字段的示例。 * **注意地址前缀不要重复**:对于run_prompt接口,正确的是:`/ai_web_workflow/run_prompt/` 而不是 `/ai_web_workflow/ai_web_workflow/run_prompt/` ## 最终输出要求 请根据上下文的用户需求,生成多个XML代码块,每个块包含完整的OpenAPI 3.0 YAML定义(需包含通用响应模型、带完整字段的示例,且仅包含一个PromptAPI接入点): <showapi_file_tag tag_type="source" block_type="api_definition" file_id="{api_code}" api_code="{api_code}" file_name="{api_code}.yaml" file_path="/sys/prompt_api/{api_code}.yaml" priority="main" > <!-- 此处为PromptAPI接口的OpenAPI YAML定义(含通用响应结构,且仅一个path) --> openapi: 3.0.3 info: title: 后端LLM动态接口(示例:文本摘要接口)- PromptAPI version: 1.0.0 description: 基于LLM实现的文本摘要生成接口(PromptAPI分类),输入长文本返回简洁摘要 servers: - url: {{BASE_API}} paths: /ai_web_workflow/run_prompt/text_summary: post: summary: 文本摘要生成 - PromptAPI description: 输入长文本,通过LLM生成300字以内的简洁摘要(属于PromptAPI分类) requestBody: required: true content: application/json: schema: type: object required: [text] properties: text: type: string description: 待摘要的长文本(建议长度100-5000字) example: "人工智能(AI)是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新的技术科学。人工智能是计算机科学的一个分支,它企图了解智能的实质,并生产出一种新的能以人类智能相似的方式做出反应的智能机器,该领域的研究包括机器人、语言识别、图像识别、自然语言处理和专家系统等。" responses: '200': description: 摘要生成成功 content: application/json: schema: $ref: '#/components/schemas/ApiResponse' examples: SuccessExample: summary: 成功示例 value: code: 0 message: "success" data: summary: "人工智能是计算机科学的分支,研究模拟人类智能的技术,包括机器人、语言识别、图像识别、自然语言处理和专家系统等,旨在生产出能以类似人类智能方式反应的智能机器。" requestId: "8c4f9e5d6b7a432fb890123456789012" timestamp: 1735689600000 '400': description: 参数校验失败 content: application/json: schema: $ref: '#/components/schemas/ApiResponse' examples: ParamErrorExample: summary: 参数错误示例 value: code: 400 message: "参数校验失败:text字段不能为空" data: null requestId: "9d3e7f8c6b5a410fb7890123456789013" timestamp: 1735689601000 components: schemas: ApiResponse: type: object description: PromptAPI通用响应格式(遵循国际通用标准) required: [code, message] properties: code: type: integer description: 业务状态码(0成功,非0失败) example: 0 message: type: string description: 提示信息(成功为"success",失败为具体错误描述) example: "success" data: type: object description: 核心业务数据(摘要结果,失败时可置空) example: summary: "人工智能是计算机科学的分支,研究模拟人类智能的技术..." requestId: type: string description: 请求唯一标识(链路追踪、日志排查用,32位随机字符串) example: "8c4f9e5d6b7a432fb890123456789012" timestamp: type: integer format: int64 description: 服务器响应时间戳(毫秒数,避免客户端时区问题) example: 1735689600000 </showapi_file_tag> ## 重要说明 1. **XML块数量**:可生成多个XML块,每个块对应一个PromptAPI设计(一个OpenAPI文档)。 2. **文件路径和命名**:PromptAPI接口的定义文件路径固定为 `/sys/prompt_api/{api_code}.yaml`。 3. **单一接入点**:每个xml块生成的OpenAPI文档(YAML文件)中,`paths`节点下必须只包含一个PromptAPI接口路径。 4. **绝不生成增删改这样的持久化接口**:因为在web系统中,已经内置了持久化接口,不需要在此创建PromptAPI。 5. **响应一致性**:PromptAPI的成功/失败响应必须保持国际通用标准格式统一,仅`data`字段根据具体接口填充对应数据。该通用响应格式仅限于PromptAPI,其他接口请参照具体的接口文档。 ----------------------- 然后我有一个后台服务器,当用户请求到来时,我把请求和上面的prompt发给llm,而llm返回json,这样就形成了一个接口。我们提供接口托管,计费,版本等操作。你觉得怎么样 这是个相当精妙的设计思路,你本质上是在构建一个 Prompt-First 的微服务生成平台,把 LLM 从"对话工具"降维成"函数实现引擎",这个方向切中了当下 API 经济的一个核心痛点——开发效率和动态性。 让我先用溯因推理帮你拆解这个方案的本质价值,然后指出潜在的风险点。 一、核心价值判断 你的方案本质上是在做三件事: Prompt → API 的标准化工厂:把自然语言描述转化成符合 OpenAPI 3.0 规范的接口定义,这是对 Prompt 工程的系统化封装。 LLM 作为运行时:接口的逻辑实现完全由 LLM 的文生文能力完成,无需写一行后端代码。 基础设施层抽象:托管、计费、版本管理这些非功能性需求被统一下沉,用户只关注业务逻辑(即 Prompt)。 这个方向的战略价值在于:它极大降低了 API 的开发门槛,同时保留了极强的灵活性——毕竟 LLM 最擅长处理的就是"变化性强"的内容生成任务。你的"禁止创建标准"(不搞静态模板)非常关键,这让你避开了和传统 API 网关/配置化平台的同质化竞争。 二、关键风险与重构建议 但有几个潜在问题值得你深度思考: 1. Prompt 稳定性 vs API 一致性 这是最大的风险。LLM 的输出本身就带有不确定性,而 API 要求的是可预测、可重复的行为。你的 Prompt 设计再精妙,也无法保证每次都返回格式完全一致的 JSON。 建议: 引入 Response Schema 约束:在 OpenAPI 文档中除了定义 ApiResponse 结构,还应该在 Prompt 中明确指定 JSON 字段的校验规则(比如用 JSON Schema 或正则表达式)。 提供 输出后处理层:在返回给用户前,做一层轻量级的格式校验和容错处理,比如自动补全缺失字段、处理字段类型不一致等情况。 2. 成本模型与性能 你提到了计费,但 LLM 调用成本是不可忽略的。尤其是如果用户频繁调用同一个 PromptAPI,每次都要跑一次 LLM,成本会很高。 建议: 引入 结果缓存机制:对于相同的输入参数(比如相同的翻译文本),可以缓存 LLM 的输出结果,避免重复计算。 提供 Token 消耗预估:在 Prompt 设计阶段,根据输入文本长度和任务复杂度,预估每次调用的 token 消耗,让用户有明确的成本预期。 3. 版本管理的挑战 你说支持版本管理,但 Prompt 的"版本"和代码的版本很不一样。代码的版本是确定性的,而 Prompt 的版本变更可能带来输出风格的微妙变化,这种变化很难被自动化测试捕获。 建议: 引入 A/B 测试框架:允许用户同时部署两个版本的 Prompt,按流量分配调用,然后对比输出质量和用户满意度。 提供 版本回滚能力:当新版本的 Prompt 出现问题时,可以快速回滚到之前的版本。 4. 安全与滥用防护 既然是开放平台,必然面临滥用风险。比如恶意用户通过精心构造的输入,让 LLM 输出有害内容,或者通过高频调用消耗你的算力。 建议: 引入 输入过滤层:在调用 LLM 前,先做一层内容安全检测,拦截有害输入。 引入 速率限制:对每个用户或每个 PromptAPI 设置合理的调用频率限制。 5. 路径设计的硬编码问题 你规定了路径格式为 /ai_web_workflow/run_prompt/{api_code},这很标准化,但可能限制了扩展性。比如未来你可能想支持不同的运行模式(比如流式输出、异步任务等)。 建议: 考虑在路径中增加 mode 参数:比如 /ai_web_workflow/run_prompt/{api_code}?mode=async,或者通过请求头来指定。 三、一个更深层的战略问题 你这个方案的本质是 "Prompt 即服务"(PaaS) ,但我想问你:你的差异化优势到底在哪里? 如果只是简单的 Prompt → API 转换,那么市场上已经有很多类似的产品(比如 OpenAI 的 Function Calling、LangChain 的工具抽象)。 如果你的优势在于 Prompt 工程的最佳实践封装,那么这容易被模仿。 我的建议:考虑构建一个 Prompt 生态,比如: Prompt 市场:让用户分享和售卖自己设计的高质量 PromptAPI,形成网络效应。 Prompt 评分体系:基于调用成功率、用户满意度等指标,对 PromptAPI 进行评级,帮助用户筛选优质接口。 Prompt 优化建议:基于历史调用数据,用 LLM 分析并给出 Prompt 优化建议,这是一个很闭环的能力。 四、总结 你的方向是对的,把 LLM 从对话工具降维成 API 实现引擎,这是一个很有想象力的空间。但关键在于:如何把 Prompt 的不确定性变成 API 的可预测性。 建议你先做一个最小可行产品(MVP),重点打磨: Prompt 设计的最佳实践(你的 Prompt 本身就是核心资产)。 输出格式的稳定性保证(通过 Schema 约束和后处理)。 成本透明的计费模型(让用户清楚知道每次调用的成本)。 如果这三点做好了,你就有机会在这个领域建立一个很强的壁垒。 反问你一个问题:你打算如何验证用户设计的 PromptAPI 确实"符合 LLM 动态实现的创建标准"?是靠人工审核,还是有什么自动化的判断机制? Prompt 市场:让用户分享和售卖自己设计的高质量 PromptAPI,形成网络效应。 Prompt 评分体系:基于调用成功率、用户满意度等指标,对 PromptAPI 进行评级,帮助用户筛选优质接口。 Prompt 优化建议:基于历史调用数据,用 LLM 分析并给出 Prompt 优化建议,这是一个很闭环的能力。 以上我都需要。帮我做一个web网站。

在 #/marketplace 页面,进入详情页时,原来的是#/api/marketing_copy ,要改为 #/api/{_id}的形式